英伟达捅了AMD一刀

留给铁娘子的时间不多了

早在2015年,全球GPU芯片龙头英伟达的创始人黄仁勋就曾犀利地评价竞争对手AMD:“我们已经好多年不看AMD的动作了,当(英伟达和AMD)差距是9跟0的时候,已经不是差距的问题了。” 在图形显示等GPU传统应用市场,英伟达长期占据了80%以上的市场份额,将AMD远远甩在后头。但随着AI大模型时代到来,AMD正试图凭借空前强大的芯片新品和难得的产业机遇,攻入英伟达的腹地。

“我在不停打仗”,在芯片界铁娘子苏姿丰(Lisa Su)的职业生涯里,有两场至关重要的战役。

第一场,是在2014年接手AMD(美国超威半导体),以力挽狂澜之势让AMD从深陷财务危机到一举成为英特尔最强劲对手,股价上涨了40倍。另一场则是在当下,今年6月,AMD发布了针对AI需求的最新款芯片Instinct MI300,这是其狙击英伟达最强劲的一个武器。

在GPU芯片领域,AMD与英伟达的缘分妙不可言。英伟达与AMD长期以“八二开”的比例瓜分着全球市场份额,在图形显示等市场并称双雄。而媒体则乐于炒作二者更私人的关系——比如,英伟达CEO黄仁勋与苏姿丰可能存在的“表亲关系”,当然,双方从未在任何场合正式回应过这些话题。

无论关系如何,黄仁勋一点都不手软,他对铁娘子苏姿丰的第二场战役迅速展开了雷霆反击。

北京时间11月13日晚间,英伟达发布了全球最强AI芯片H200,其性能较H100直接翻倍。打了抢先发布MI300的AMD一个措手不及。此前,AMD表示,公司正在今年第三季度向客户提供样品,产量将在第四季增加。原本MI300将有望成为AMD最快销售额破10亿美元的产品。

英伟达称H200将在2024年第二季度开始交付,留给AMD抢跑的时间不多。

AMD开打第二场“翻身仗”

AMD还是乐观了。

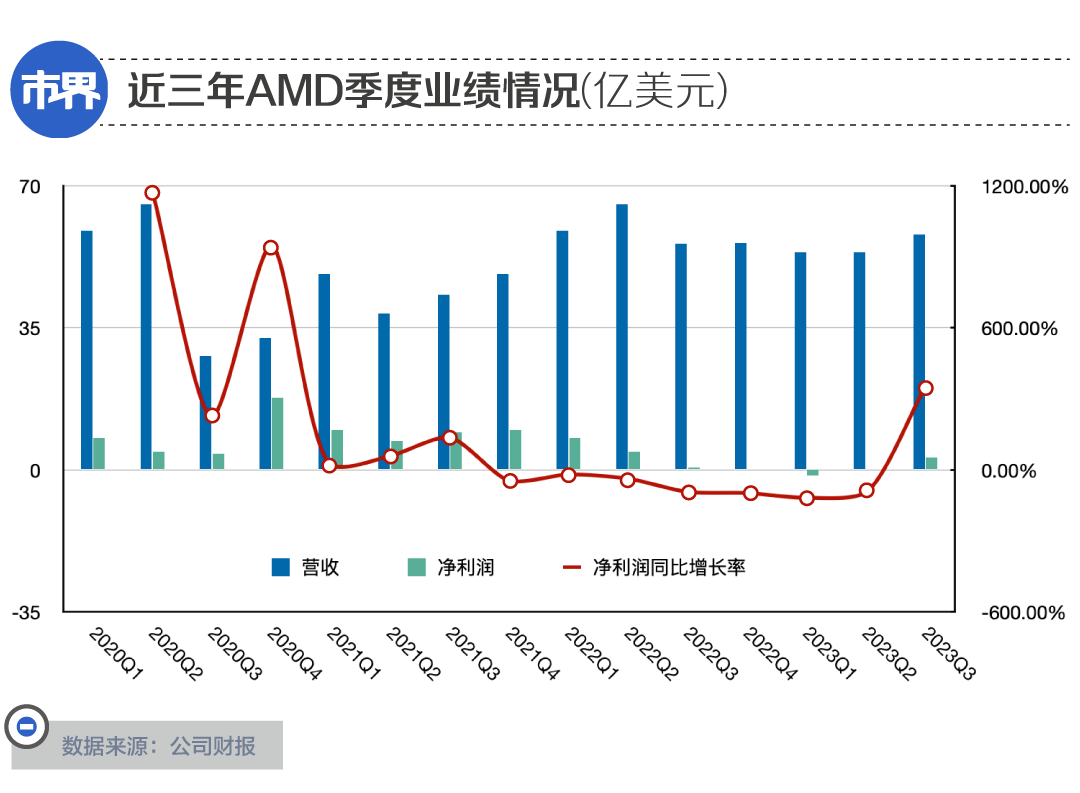

今年Q3财报发布之际,AMD曾大胆给出业绩预期:四季度营收将达到58亿美元至64亿美元之间,预计为61亿美元,同比增长9%——这也将是AMD自2022年第三季度以来,最高的季度收入。

这种预期也可以理解,2023年第三季度,AMD营收58亿美元,净利润2.99亿美元——是连续7个季度的净利润同比下滑之后,首次实现季度净利润的同比正增长。

而AMD几乎将自己未来业绩强劲增长的底牌,全部押注在了一款产品上:

今年6月份,AMD专门针对AI大模型训练需求发布的Instinct MI300系列芯片。这几乎是全球范围内,第一款能够直接对标英伟达大模型训练芯片H100的产品。

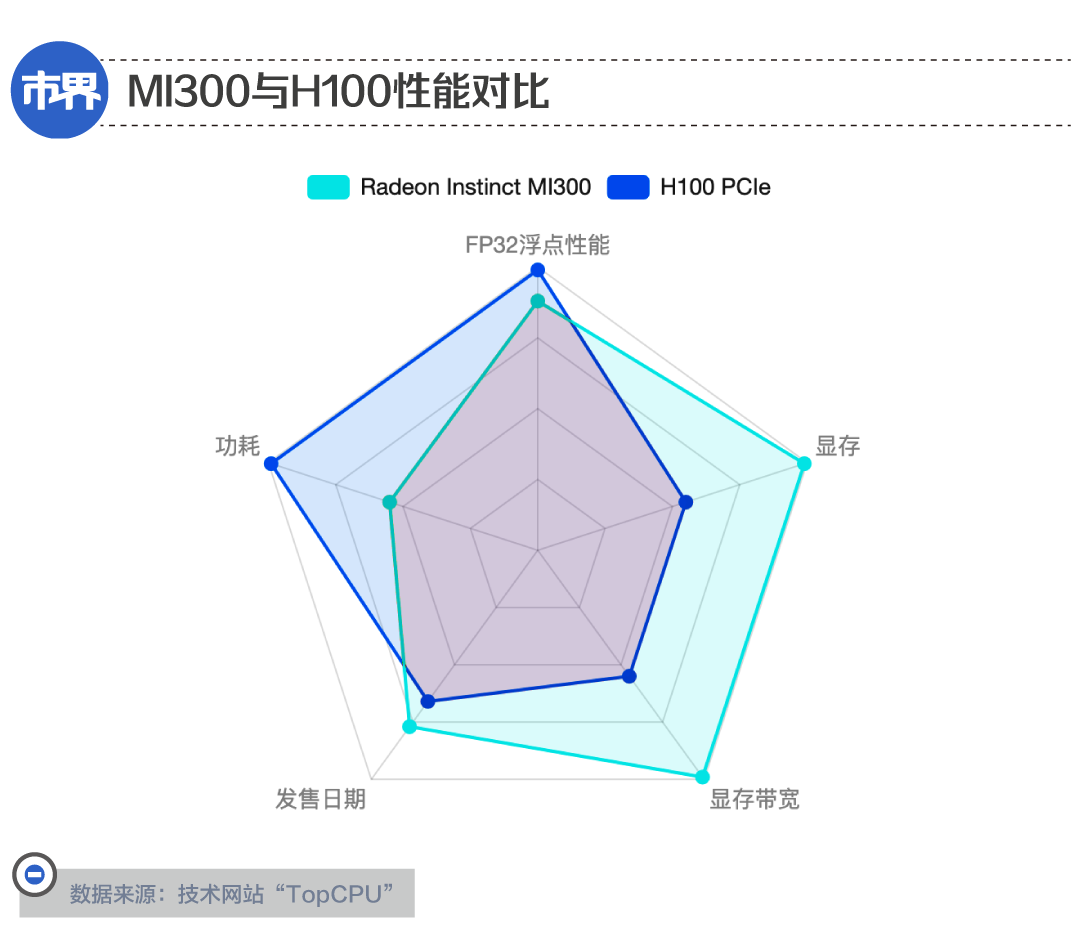

根据AMD官方信息,MI300在部分技术指标上相比英伟达的H100更具优势,比如MI300提供的HBM(高带宽内存)密度是H100的2.4倍,HBM带宽是H100的1.6倍。这意味着AMD可以运行比英伟达H100更大的模型。

惊艳四座的ChatGPT大模型大部分基于英伟达2020年发布的A100芯片进行训练。而在2022年3月份,英伟达面向AI大模型训练需求专门发布了H100芯片。

从亮相开始,H100就迎头赶上了“百模大战”的风口,成为了被各方力量争夺的宝贵算力资源。据坊间传闻,早在今年第三季度时,英伟达H100的订单就已排到了2024年,至今产品稀缺程度有增无减。

尽管如此,在发布会上苏姿丰还是表现得十分有信心:“我们认为,数据中心人工智能加速器(市场)将以超过50%的复合年增长率,从今年的300亿美元左右增长到2027年的1500亿美元以上。”

AMD计划在第四季度量产MI300。在此基础上,公司预计在第四季度,包含MI300在内的数据中心GPU业务营收将达到4亿美元;而在整个2024年,公司数据中心GPU产品有望实现20亿美元的销售额。

AMD数据中心GPU产品的下游市场既包括科学计算等高性能计算领域,也包括AI领域,但苏姿丰认为后者才是业绩的主要增长动力:“随着2024年的到来,我们预计收入将继续按季度增长,而且,这将主要来自人工智能。”

而其中MI300被寄予厚望,将成为该公司“有史以来最快达成10亿美元销售额的产品”。

此前,AMD虽然在GPU市场名列第二,但主要应用于图形处理、消费级产品等传统GPU应用场景,在AI和高性能计算领域始终存在感较低。

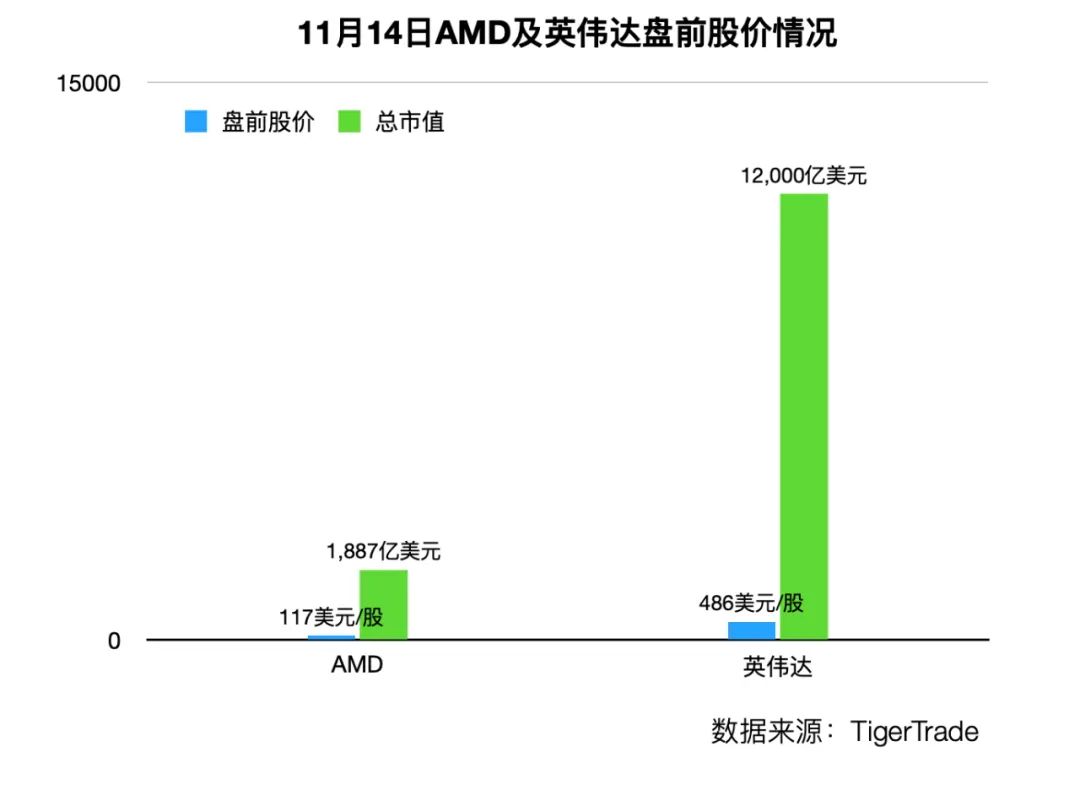

从MI300的性能指标而言,AMD本来已经几乎具备了与英伟达叫板的能力,直到H200横空出世。在H200发布会结束结束后,AMD收盘股价下跌1.52%。

在未来,AMD想要在如火如荼的AI技术市场中抢得一席之地,面前的压力仍毋庸多言。

至今AMD尚未公布MI300的官方定价,但市场预计,为了增加与英伟达的竞争筹码,AMD MI300或许不得不延续其在传统GPU市场的性价比路线。

不仅如此,为了完成预期业绩,AMD还于10月份在上海启动了一轮裁员“瘦身”。

据一位AMD前员工对「市界」透露,本次AMD给出的赔偿条件是“N+3”倍的月工资,主要涉及的部门为SoC(系统级芯片技术部门)和RTG(Radeon系列显卡技术部门)。

一步慢,步步慢

大模型时代,AMD等来了一个翻身机遇,只是对这份机遇AMD做出的反应还是晚了。

一位在国内高校任职的AI研究人员告诉「市界」:“除了媒体报道的韩国(指该国电信运营商’KT’)使用AMD Instinct平台运行了AI大模型的新闻,在日常研究里,我还没有接触或了解到使用AMD芯片训练的项目。”

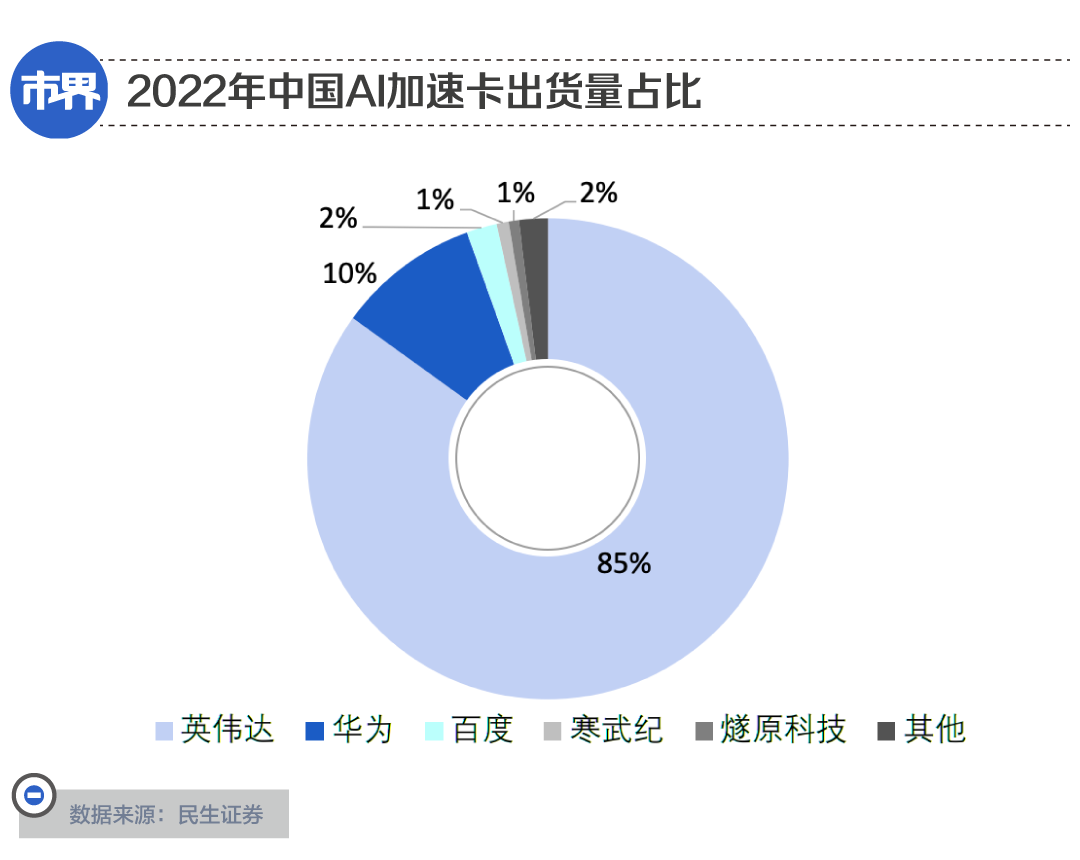

这种情况也反映在了市场数据上,据IDC调研,2022年中国AI加速卡(即AI训练芯片)出货量约为109万张,其中英伟达在中国AI加速卡市场份额为85%,华为市占率为10%,百度市占率为2%,寒武纪和燧原科技均为1%。根据这组数据,AMD的AI训练芯片在国内市场甚至“没有姓名”,沦为其他。

不仅如此,亚马逊AWS、谷歌、腾讯云等全球主要云厂商的AI芯片也大多来自英伟达及自研,采用AMD产品的占比较小。

追溯形成显著市场差距的原因,可以将目光转向多年之前。

英伟达创始人黄仁勋曾这样总结:“我们很早地,大约在10年前就发现,(AI)这种制作软件的方式可以改变一切。我们从底层一直到顶层,从各个角度改变了公司。”

在一家美国GPU独角兽企业担任市场总监的Lee告诉「市界」:“早在2012年,英伟达就开始投入在深度学习的计算了,而且是在全公司范围内贯彻执行。”而这相较业内普遍意识到AI芯片的重要性,至少早了四五年的时间,领先一个身位。

从2016年开始,英伟达旗下的加速计算GPU产品线(代号“Tesla”)开始专门针对AI训练任务进行设计。这一年推出的芯片型号为P100,同时配备有英伟达新研发的高速互联技术“NVLink”。而NVLink能够允许CPU、GPU芯片间进行高速交互,进一步提升了运算效率,至今仍是英伟达AI芯片中的核心技术之一。

还是在这一年,英伟达向后来推出了ChatGPT的OpenAI捐出了一台搭载了8块P100芯片、价值百万的超级计算机“DGX-1”。在这台超算的机箱上,黄仁勋亲手写道:“为了计算和人类的未来,我捐出世界第一台DGX-1。”

后来的种种迹象都表示,这段时间正是人工智能的黄金发展期。正是在2016年,谷歌Alpha go击败了围棋大师李世石,被视为AI技术迈上新台阶的重要标志。不仅如此,AI相关产品、硬件、软件等的市场规模已经超过80亿美元,纽约时报评价称“AI已经到达了一个热潮”。

反观同一时期的AMD,虽然同样试图在AI方面有所布局,但彼时其重心更多放在CPU业务线上,并未像英伟达一样全面押注。

2016年,AMD正式推出Radeon Instinct系列产品线,旨在加速深度学习、神经网络和高性能计算等方面应用。

然而从产品更新情况而言,AMD对旗下AI芯片的设计显然不够“上心”。在之后的4年间时间里,Radeon Instinct系列虽然不断更新,但始终与AMD的消费级显卡Radeon公用基础架构,在计算方面缺乏针对性和高效率,难以满足AI训练的需求。

直到2020年,这种情况才有所转变。这一年,AMD将AI芯片产品线更名为“Instinct”,并首次抛弃了以往的消费级显卡架构,为其采用了专门设计的CNDA计算架构。

在此之后,AMD连续更新了三代产品MI100、MI200,以及最新发布的MI300。凭借全新的技术路线,以及采取高性价比的市场策略,AMD才开始在AI训练市场中有人问津。

只是,在AMD“缺席”AI市场的几年里,英伟达已经建立起了极强的生态壁垒。

英伟达建筑的高墙

Lee这样向「市界」描述英伟达在AI领域树立的优势:“真正难的并不是说比别人跑的多快,而是围绕着这一个主题,进行全方位点点滴滴的下注,从语言设计到开发者工具这些周边的东西才是最难得的。”

而周边工具一旦被用户所接受,“客户技术迁移的成本将会是难以想象的高”。

资深AI从业者路云的说法也从侧面印证了这一点,据其回忆:“早在大约10年前,我们学校就给高性能计算相关专业的学生开设了基于CUDA的课程。”

CUDA是英伟达在2006年推出的通用并行计算架构,借助CUDA提供的编程接口和工具集等,开发者可以基于GPU芯片编程、运行复杂的AI算法等等。

全球顶尖AI学者、前百度首席科学家吴恩达曾这样评价CUDA:“CUDA出现之前,全球能用GPU编程的可能不超过100人,有了CUDA之后使用GPU就变成了一件非常轻松的事情。”

这样一代代的开发者和研究者,用汗水浇灌出了英伟达的强大生态。换句话说,即使AMD MI300的官方性能指标相比英伟达H100体现出优势,后者的生态壁垒仍旧难以逾越,更别提H200展现出了更强的性能指标。

这样的背景下,AMD想要逆风翻盘,除了着力补上生态差距,还不得不在市场策略上别出心裁。

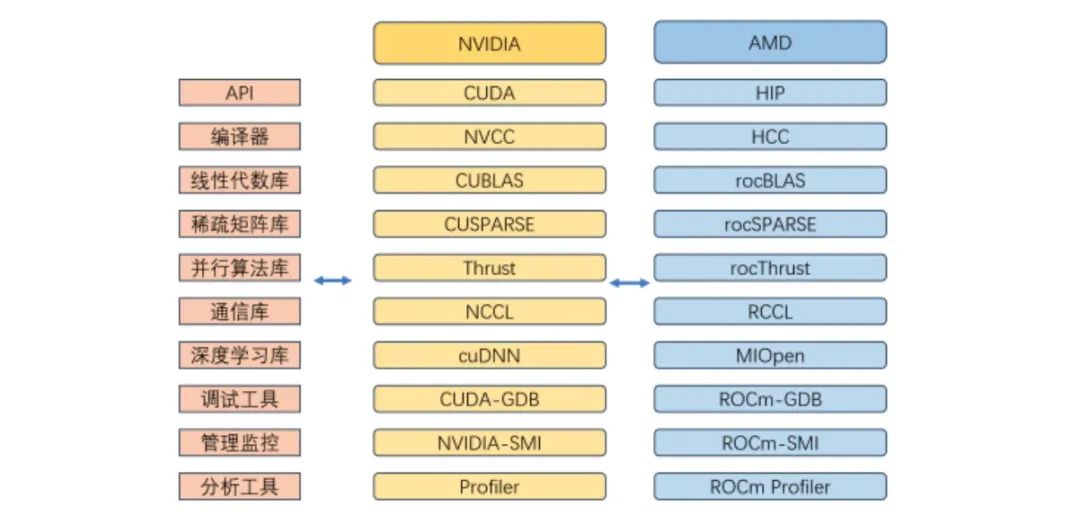

生态方面,2016年,AMD推出了对标英伟达CUDA的ROCm架构。据东吴证券研报,由于ROCm平台起步晚,其对于GPU加速库的支持没有英伟达CUDA全面。CUDA的应用场景基本能够覆盖全场景,但ROCm更多用于高性能计算领域,对AI的覆盖稍显不足。

至今,AMD ROCm平台的工具链已经相对完善,并且能够兼容英伟达的CUDA平台。此外,为了进一步优化软件生态,AMD还在2023年10月份官宣收购了AI软件企业Nod.ai。

对此东吴证券研报评论道:AMD的软件生态在公司大力投入和其它厂商积极扶持下,有望彻底改善。

(英伟达与AMD软件生态工具链完善程度对比。图源/东吴证券)

另一方面,AMD高性价比的市场策略将是其在AI领域的另一大优势。联博资产管理公司的分析师Stacy Rasgon认为,提供’平替版的英伟达’,将是AMD争取市场支持的关键。

AI研究公司Cambrian AI Research则分析称,大公司需要“第二供应商”的战略将为AMD提供机遇:“像OpenAI和微软这样的公司需要有一个能替代英伟达产品的选择,AMD可能会给他们一个无法拒绝的提议,但不要指望能从英伟达那里抢走很多份额。”

无论如何,大模型产业疾速发展带来了巨大的算力缺口:根据OpenAI 数据, 模型计算量增长速度远超人工智能硬件算力增长速度,两者之间存在万倍差距。

对于长期在AI领域缺乏存在感的AMD而言,它正迎来了最好时机。

本文来自微信公众号“市界”(ID:ishijie2018),作者:董温淑,编辑:董雨晴,运营:刘珊,36氪经授权发布。

免责声明:上述内容仅代表发帖人个人观点,不构成本平台的任何投资建议。