新栏目上线试运行。

文丨贺乾明

编辑丨黄俊杰

11 月,ChatGPT 迎来两周年,却是 OpenAI 官方相对沉寂的一个月。

这只是暂时的。12 月 4 日,OpenAI 宣布开启为期 12 天的发布活动,每个工作日发布一款产品或一项进展,当前已经发布了完整版的 o1 模型,每月 200 美元的会员 ChatGPT Pro,用强化学习的方式微调模型的方法,视频生成模型 Sora,以及调动 ChatGPT 更好写作和编程的功能 Canvas。

OpenAI 的密集发布是为了追求更快的增长,也间接回应了过去一个月达到高峰的质疑。

更多数据、更多算力,训练更大规模的模型,就能显著提升能力。过去两年,大模型行业沿着这条经验总结前行:买 GPU 建更大的数据中心,不惜官司缠身也要采集更多数据,想办法扩大模型体量。

到了 11 月,越来越多的人说,成就 OpenAI 的这条路似乎撞到了墙:

-

硅谷风投 a16z 创始合伙人、投资了 OpenAI 等多家大模型公司的马克·安德森(Marc Andreessen)说:“我们以相同的速度增加(GPU),根本没有智能提升。”

-

OpenAI 联合创始人、前首席科学家伊尔亚·苏茨克维 (Ilya Sutskever) 说:“2010 年代是扩大规模的时代,现在我们再次回到了需要奇迹和新发现的时代。”

多家媒体报道,Google、OpenAI、Anthropic 等公司,开发下一代模型时,都没能像前些年那样让模型能力大幅提升。

这些公司的高管否认了 “撞墙” 的说法,也有证据表明他们仍在想办法突破,毕竟建设更大规模的算力中心的势头并没有放缓,甚至还在加速。

他们同步在大模型应用上倾注更多的资源。从 OpenAI、Anthropic 到 Google、微软,再到风投机构,都把 Agent——让大模型理解人类指令,调度数据库和工具完成复杂任务的系统——当作下一个赛点。

同时,过去两年整个行业不留余力推广大模型应用的影响也开始显现。比如大模型领域最成熟的 AI 编程场景,开发者工具供应商 GitClear 分析了 2020 年以来其客户提交的 10 亿行代码数据,发现大模型编程应用普及期间,开发者复制粘贴整行代码的频率在提升。他们认为,这意味着开发者更频繁地添加 AI 生成的代码。

结果是,开发者提交代码两周内,恢复、删除或更新代码的比例增加了 39%。毕竟 AI 还是有幻觉。

这也成了新创业者的机会。专注 AI 编程工具开发的 Cursor 在 11 月拿到新一轮融资,估值达到 25 亿美元。他们在产品中引入自动审查、修复代码 bug 的功能,在微软、Google 等公司的合围中找到了发展路径。

中国公司很难在算力投资上与美国的大公司比较,但也在用力所能及的方法参与竞争。阿里巴巴、字节跳动、美团等公司正在硅谷积极招聘人才组建团队。11 月,阿里还在海外推出对话式 AI 搜索引擎 Accio。

以上只是 11 月大模型行业发生的部分变化。接下来,我们计划每个月发布一篇综述报道,力求完整地为大家介绍全球 AI 新风向。

除了技术、应用、投资、人才等领域的动向,我们还会重点关注整个行业如何应对变化,以及这些变化如何影响世界。

以下是我们第 1 期 AI 月报,记录 2024 年 11 月 AI 的进展。欢迎大家在留言区补充我们没有提到的重要进展。

技术丨大模型能力提升撞墙了?这里有一些新尝试

瓶颈的信号:OpenAI 新模型 Orion 性能提升不及前代

11 月,AI 行业讨论最多的话题,是大模型能力提升是否撞墙了。

-

11 月 9 日,The Information 在一篇报道中提到,OpenAI 正在训练的下一代模型 Orion,性能虽然比现在的好,但提升幅度远不及 GPT-3 到 GPT-4;而且在编码等任务中,表现还不如原来的模型。

-

11 月 13 日,Bloomberg 发布报道,称 Google、Anthropic 训练更强的大模型时,都遇到了和 OpenAI 类似的状况。

历史新发现:百度早研究出了 Scaling Laws 的雏形

在这之前,大模型能力提升有一个明确的规律:即用更多数据、更多算力,训练更大规模的模型,就能显著提升能力,这被称为 Scaling Laws。

行业中普遍认为,这一规律由 OpenAI 的研究者在 2020 年发现,然后发扬光大。

11 月底,Meta 的一位研究员发现,百度早在 2017 年,就在一篇论文中介绍了 Scaling Laws 的雏形。

当时百度在硅谷招揽了一批人才研究 AI,如顶级 AI 科学家吴恩达、Anthropic 创始人达里奥·阿莫迪(Dario Amodei)等。他们在一篇论文中介绍了用更多算力训练更大的模型会有更好的效果。

只不过他们的研究只在语音和文字上测试,没涉及语言处理,也没用上关键的 Transformer。后来达里奥·阿莫迪加入 OpenAI,与伊尔亚·苏茨克维等人继续推进研究,提出了 Scaling Laws。

瓶颈之后,可能的新方向

现在,Scaling Laws 似乎遇到了问题。

为什么这样也不难理解:整个行业缺乏新鲜的高质量数据训练模型——当前领先的大模型,已吞噬了市面上所有的公开(还有一部分非公开的)高质量数据。

1. 合成数据

许多公司在寻找新的办法解决数据问题。

如 OpenAI 就在用在 9 月发布的 o1 生成用来训练 Orion 的数据,这类数据被称为 “合成数据”。

合成数据并不完美,如果用不好很难提升模型的效果。OpenAI 训练 Orion 的结果并不理想就是一个例子。

2. 使用更高精度的数据

还有一部分研究者寻找其他路径提升模型性能,比如哈佛、斯坦福、MIT 等机构的研究者,在 11 月 7 日发布论文提出了一个现象:用更低的数据精度训练或推理语言模型,会影响质量,当前的 Scaling Laws 并没有考虑到这一点。

这里的精度,是指计算机表示数据的位数,最早的时候,研究者用 64 位字符串表示一个字,精度最高。近年来,为了提升大模型的速度,降低算力成本,许多公司减少到 32 位、16 位,到现在的 8 位,但精度也有损失,会影响模型的性能。

3. 从预训练到后训练

以上的尝试和合成数据,属于预训练(Pre-Training)阶段,还有一些研究人员专注后训练(Post-Training)阶段,让训练好的模型在解决问题时,能够发挥更好的效果,比如问模型一个问题数十次,甚至上百次,选择最好的答案。

相对主流的方法是让大模型回答问题时,用更多的时间 “思考”,也就是 OpenAI o1 的路线。Google、Meta 等公司也在做同样的尝试。

在中国,从阿里巴巴、DeepSeek、月之暗面,再到上海 AI 实验室、昆仑万维等公司,都在 11 月发布了类似 o1 方向的模型,有些公司甚至给模型的名字加上了 o1,暗示能追上最新的技术。

大语言模型之外,Google 的 AI 量子工具

11 月 20 日,Google 量子 AI 和 DeepMind 在《自然》杂志上发布论文,介绍了一种命名为 AlphaQubit 的 AI 工具,能比现有方法更有效地减少量子错误(减少 6%、30%)。

量子计算时可能会受到各种因素的破坏出现错误,比如热量、振动、电磁干扰,甚至宇宙射线。当前量子计算机每次操作的错误率通常为 1% 到 10%,如果把它用于药物发现、材料设计和加密,错误率要低于 0.000000001%。

大模型竞争丨OpenAI 摇晃的第一

OpenAI 企业市场份额下降,从 50% 到 34%

因技术放缓,OpenAI 面临着来自同行越来越大的竞争压力:

11 月,非营利组织 METR 发布一项评估结果,解决 7 个人工智能研究问题时,Anthropic 的 Claude Sonnet 3.5,在其中 5 个中表现超过 OpenAI 的 o1-preview。

根据风投机构 Menlo Ventures 的数据,今年 OpenAI 在企业 AI 领域的市场份额从 50% 下降至 34%,而亚马逊支持的 Anthropic 的市场份额翻了一番,从 12% 增至 24%。

xAI、Anthropic、Writer 等大模型公司 11 月获新融资

OpenAI 依旧被投资人看好。o1 发布没多久,软银就宣布以 1570 亿美元的估值投资 OpenAI 5 亿美元。软银 CEO 孙正义还想要更多股份,11 月开始,他们正在花 15 亿美元从 OpenAI 员工手中收购股票。

一批大模型公司也在 11 月获得资本支持:

-

马斯克的 xAI 在宣布融到 50 亿美元,投后估值达到 500 亿美元,是今年初估值的两倍多。今年以来,xAI 已经融到了 110 亿美元。

-

亚马逊宣布向 Anthropic 追加 40 亿美元投资,算下来它已经投了 Anthropic 80 亿美元。按照 Anthropic 的说法,亚马逊依然是个小股东,在董事会中也没有席位。

-

成立于 2020 年的 Writer,以 19 亿美元筹到了 2 亿美元,投资者中有 Salesforce、Adobe、IBM 公司的风投基金。这家公司正在开发一款 “自动进化” 的大模型。在训练阶段,他们会在大模型中增加一个 “内存池”,存储之前交互中的重要信息,大模型投入使用时遇到没处理过的信息,都会更新 “内存池” 的信息。

Sora 终开放,不再震撼;Runway、腾讯视频生成模型 11 月更新/发布

在图像和视频生成等模型方向,OpenAI 也同时面临内外挑战。11 月 26 日,一群拿到 OpenAI 视频生成模型 Sora 的艺术家组成的组织,在 Hugging Face 上公开了 Sora 的 API,供人调用。他们说,OpenAI 让他们免费给 Sora 找 bug,但并不注重创意表达和大家的批评,只顾着公关和宣传。

12 月初,OpenAI 终于发布 Sora,但已经没有初次亮相的惊艳感。

对手们并没有慢下来。过去这个月,Runway 上线视频拓展功能;腾讯开源视频生成模型 HunyuanVideo,旗帜鲜明对标 Sora。

多模态、具身大模型公司获融资

-

2023 年成立的 Moonvalley,11 月筹集了 7000 万美元种子轮资金。该公司的目标是训练 “透明” 的视频生成模型——如果创作者或客户发现模型使用了他们的作品,可以提出删除,他们甚至会给赔偿。

-

在图像领域,今年成立的 Black Forest Labs,以 10 亿美元估值筹到 2 亿美元,它是研发文生图模型 Flux 的开发者(它在 Telegram 中出现频率挺高,用于特别目的),也是马斯克旗下 xAI 的 Grok 应用图片生成服务供应商。

-

今年刚成立的 Physical Intelligence, 以 24 亿美元的估值获得 4 亿美元融资。他们要为机器人开发大脑,把通用人工智能与机器人等物理设备结合,已经发布名为 π0 的基础模型。

-

2023 年成立的银河通用筹到 5 亿元人民币。他们没有像大多数公司那样做完整的人形机器人,认为做人形机器人双腿在当前不是最优解,只是徒增成本。他们正在尝试用海量的合成数据训练机器人模型,让它具备更多能力。这里有我们与银河通用创始人王鹤的对话。

-

2023 年成立的星海图筹到 2 亿元人民币。他们认为,要做出通用机器人,最重要的不是物理形态,而是能适应各种形态的、相对通用的智能。这就像哺乳动物形态各异,但都有基础的感知、判断、运动能力,部分还具有会使用工具等相对高级的智能。这里有我们与星海图创始团队的对话。

算力丨更多 GPU 放在一个地方的竞赛还在继续

大公司今年花了 2000 亿美元建算力中心,明年可能会加大力度

“对于大科技公司来说,资本支出是新的并购吗?”

11 月举办的高盛年度私营会议上,高盛的银行家提出了这样一个问题。他们发现,今年价值超过 5 亿美元的科技并购交易,一半以上由私募股权公司完成,远远高于历史正常水平,而大公司的并购支出下降了 56%,而主要用于建设数据中心的资本支出增加了一倍多。

大模型的能力提升速度有了放缓迹象,并没有打消整个世界的 AI 投资热情。大公司们还在用一种简单直接的方法衡量谁能在 AI 竞赛中获胜:能将最多的 GPU 放在一个地方的公司。

仅亚马逊、微软、Meta、Google 四家公司,今年的资本支出就会超过 2000 亿美元。他们的高管们在 11 月称,明年会继续投资,甚至还会加大投资力度。

Anthropic 的 CEO 达里奥·阿莫迪在一档播客中说,2026 年将出现耗资超过 100 亿美元的计算集群,他说许多公司希望建立耗资 1000 亿美元的集群。

其中之一可能是 OpenAI,他们在 11 月发布的政策文件中呼吁建立 “北美 AI 契约”,提议建造一个可能耗资 1000 亿美元的数据中心。

竞赛催化剂:马斯克 122 天建成数据中心

埃隆·马斯克(Elon Musk) 7 月宣布用 122 天把一个家电厂房改造成 10 万张 H100 计算集群,并投入使用,相当于在科技行业扔下一枚炸弹。

“毫无疑问,没有人睡觉 ...... 据我所知,世界上只有一个人能做到这一点。” 英伟达 CEO 黄仁勋在一档播客中说,这种规模的 GPU 集群,通常需要三年时间设计、建造,然后再过一年才能投入使用。

The Information 在 11 月发布的一篇报道中提到,OpenAI CEO 山姆·阿尔特曼(Sam Altman)看到马斯克在 X 上发布的消息后,跟微软负责基础设施的高管发生了争执,他担心马斯克的 xAI 很快就会拥有比 OpenAI 更强的集群,发展速度更快。报道中还提到,因为戒备森严,有竞争对手乘坐直升机飞到马斯克建成的集群上方拍视频,试图了解更多信息。

沙特、波兰、日本宣布 AI 投资计划

还有一些政府宣布了 AI 投资计划:沙特阿拉伯计划向 AI 创业公司和数据中心投资 500 亿到 1000 亿美元;波兰宣布投资 2.44 亿美元开发波兰语大模型;日本宣布投入 650 亿美元支持芯片和 AI 等等。

对手在行动,英伟达也在扩张

英伟达是大公司数据中心竞赛中最大的受益者,为了保证竞争力,他们加快产品迭代的速度:从原来 2 年更新一代产品变成了 1 年一代。

今年 3 月发布 Blackwell 系列 GPU 是英伟达加快产品迭代速度的第一个尝试,本来计划年中交付,但它们在定制的服务器架上把 GPU 连接在一起会过热。英伟达多次要求供应商修改机架设计,一直拖到了 11 月,似乎还没有解决问题。

11 月,2020 年成立的芯片公司 Enfabrica 获得 1.15 亿美元 C 轮融资,开发用于 GPU 互联加速的网络架构芯片。一定程度上来说,它是英伟达 GPU 在网络芯片领域的竞争对手,认为自己能比英伟达更好地帮企业用好 GPU。

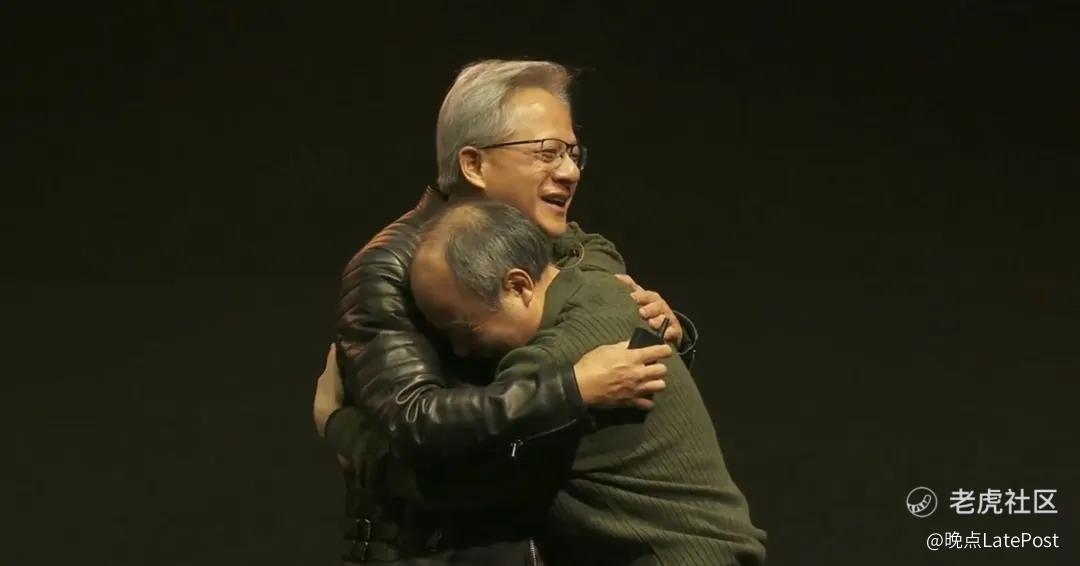

英伟达更直接的竞争对手也在积极行动。黄仁勋在这个月的英伟达日本峰会上调侃软银 CEO 孙正义:“你能想象,要是你成为了英伟达最大的股东会怎样?” 孙正义随即抱住黄仁勋,假装痛哭。这个活动举办的同时,软银收购的 AI 芯片公司 Graphcore 正在积极扩张,4 个月内增员 20%。

英伟达还在继续拓展产品线,其高管在 11 月说,计划明年上半年发布一款专门为机器人设计的芯片 Jetson Thor。英伟达显然不愿意错过任何一个技术热点——不管是不是泡沫,卖芯片总不会亏。

应用丨更多人用上大模型 ,Agent 成了下一个赛点

大模型融入工作和生活的进度表

ChatGPT 上线两年,大模型应用已成为许多人工作和生活的一部分:

-

风投机构 Menlo Ventures 11 月发布数据,今年企业在生成式 AI 方面的支出飙升 500%,达到 138 亿美元。

-

OpenAI 在 11 月透露,ChatGPT 的周活用户达到 2.5 亿,所有互联网产品中只有抖音有这个速度。12 月初,这个数据更新到了 3 亿。

-

AI 检测公司 Originality AI 发现,从 2018 年到今年 10 月,LinkedIn 上的长帖子,54% 可能是 AI 写的。

比较有趣的一个报告来自协同办公应用 Slack,他们调查了 15 个国家的 1.7 万名员工在工作中使用 AI 的情况,11 月 19 日发布报告:

-

截至 8 月,受访者在工作中使用 AI 的比例达到 36%,与 2023 年 1 月相比提升了 16 个百分点。

-

受访者使用 AI 最多的 5 个场景,分别是:(1)领导发信息(2)给同事发信息(3)评估下属绩效(4)给客户写邮件(5)头脑风暴。

鲜明对比:不愿透露使用 AI 的白领、坦诚的苹果 AI 广告、态度积极的高管

Slack 还发现了一个现象:使用 AI 工作的员工中,有近一半(48%)不愿告诉领导自己在工作中用了 AI——他们担心领导觉得他们懒、骗人或无能。

相比他们的羞于启齿,苹果 11 月发布的 Apple Intelligence 广告显得无比坦荡:

-

一则广告中,主角看上去就是一个无所事事的办公室混子,邮件都写不好,在 Apple Intelligence 的帮助下,写出来让领导欣赏的邮件。

-

另一则广告中,主角开会摸鱼,被领导抓住,要他分享一份招股书的要点,他毫无准备,但在 Apple Intelligence 的帮助下应付了过去。

广告结尾,苹果还配上了 “我是天才” 的背景乐。没什么意外,广告上线后就引起骂声一片。苹果没有下线这些广告,而是关上了广告视频的 YouTube 评论区。

企业高管使用 AI 似乎没那么大的心理压力。宾夕法尼亚大学沃顿商学院和咨询公司 GBK 调研了 800 名公司决策层,他们中近 72% 的人说自己每周至少用一次生成式 AI,与前一年相比翻倍增长。

AI 编程不完美,但它是竞争焦点

大公司高管不回避员工高频使用大模型应用,尤其是编程工作。Google CEO 桑达尔·皮查伊 (Sundar Pichai) 说,Google 四分之一以上的新代码是 AI 写的;微软高管也透露,AI 编程助手 GitHub Copilot 生成了自己启动文件中近一半的代码。

大模型还不完美。有资深的程序员曾告诉我们,他因为太信任 AI,过去一年写出来了不少 bug。

更多资源还在涌入 AI 编程领域。当前几乎所有开发大模型应用的公司,都推出了 AI 编程助手,并重点迭代。

11 月,OpenAI 把桌面版的 ChatGPT 与 VS Code、Xcode、TextEdit、Terminal 等编程工具打通,开发者不用把代码复制粘贴到 ChatGPT 应用中,就能调用 ChatGPT 处理代码。

除了开篇提到的 Cursor,还有两家 AI 编程创业公司获得了超过 5000 万美元的投资,但侧重有所不同:

-

Tessl,2024 年成立,以 7.5 亿美元的估值筹到 1.25 亿美元,目前有 20 多位员工,要做能开发软件的 AI 应用,计划明年初推出产品。

-

Lightning AI,2019 年成立,筹到 5000 万美元,主要的业务是开发软件,帮开发者简化流程,更方便地开发 AI 应用。

不少国内的投资人也向我们透露了想要投资 AI 编程应用的想法。我们曾提及,月之暗面原 Noisee 产品负责人,1998 年出生的明超平在 9 月底离职后创业做 AI 编程。据了解,这家公司在 10 月到 11 月已完成两轮融资。

从 OpenAI 到苹果,推广大模型应用的各种方法

大模型行业的参与者,也都在积极探索新的方式,让更多人用上大模型应用。以下是部分头部公司在 11 月的动作:

OpenAI:与非营利组织 Common Sense Media 合作,发布免费在线课程,教中小学老师如何在上课的时候用 ChatGPT;考虑开发一款与 ChatGPT 结合的浏览器,还打算为旅游、食品、房地产和零售网站提供搜索功能,已经与部分公司接洽;把最新的模型 o1 推给企业客户,比如法律、医疗保健等行业。

微软:在协同办公应用 Teams 中测试 AI 翻译器,可以模仿说话人的声音,提供 9 种语言的实时翻译;推出 Azure AI Foundry,帮助客户构建 AI 应用程序;谈下农业公司拜耳,一起向农业领域客户销售 AI 服务。

Google:为 Gemini Advanced 付费用户推出名为 “记忆” 的功能,它可以记住用户透露的兴趣和偏好。

苹果:正在开发一款内置 Apple Intelligence 的壁挂显示器;开发对话版本的 Siri,想追上 ChatGPT 等产品。

Anthropic:在 Claude AI 中增加了自定义风格的功能,用户可以从默认的选项中选择语气,也可以训练它匹配自己的风格;与 Palantir 和 AWS 合作,为美国情报和国防机构提供 Claude 系列模型的访问权限。Meta 也在做类似的事。

Perplexity:探索新的变现方法,在原来会员订阅的基础上加广告,推出购物模式等。这个月,它以 90 亿美元估值筹到 5 亿美元。

说到商业模式,这个月还有一家名为 ProRata.ai 的公司获得 1.3 亿美元融资,它于 2024 年成立,创始人是当年提出搜索引擎广告按点击收费的比尔·格罗斯(Bill Gross)。

他们想要建立大模型搜索引擎的商业模式:依靠算法把大模型输出的结果拆分,找到结果中使用的版权内容,根据比例向版权方付费。他们已经发布一款搜索引擎,还获得了《卫报》《金融时报》《财富》、 环球音乐集团等大型内容版权方的支持。

精彩评论